别再交那种“被动等待税”了,赶紧换成主动出击的 Proactive AI 吧

你坐下来,端起咖啡,打开产品积压工作列表(backlog)。上周攒下的 140 条功能请求、Bug 报告和销售笔记还没分类。你打开 Microsoft Copilot,光标在那儿一闪一闪。

它在等你。你得写出完美的提示词(prompt),才能从它那儿榨出点价值。你得明确告诉它读哪些文档、参考哪些 Jira 史诗任务(epics)、输出什么格式。你还得拼命回想昨天那个反馈文件到底叫什么名字。

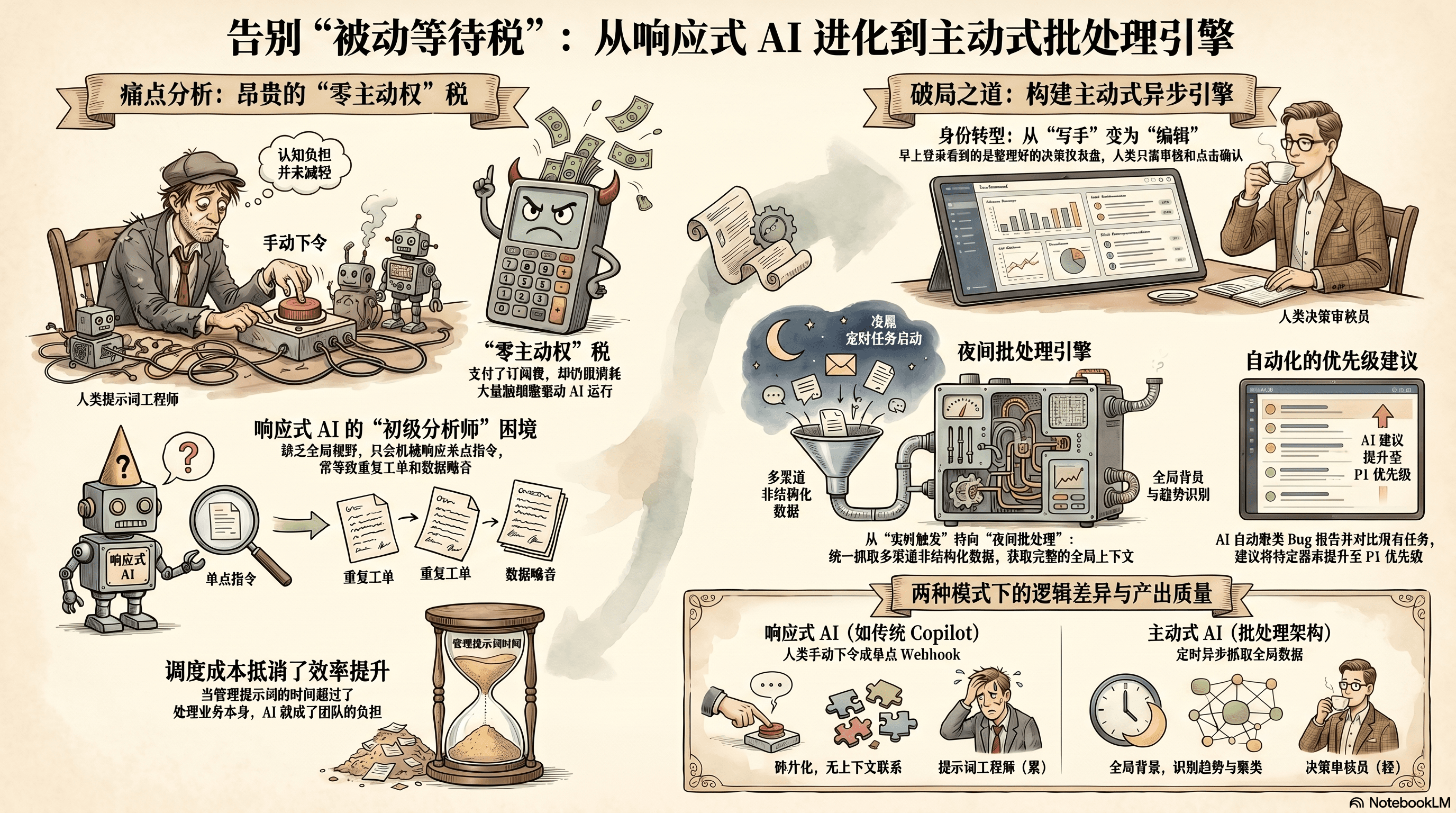

这就是现在产品管理的现状。我们买 AI 是为了让它干重活,结果自己却成了全职的「提示词工程师」。认知负担一点没减,只是从「读工单」变成了「写指令」。真挺累的。

「零主动权」税

AI 缺乏主动性,结果就是「零主动权税」:你得花大把时间手动搜集数据和背景来伺候它。

所谓的「零主动权」税(zero-initiative tax),就是你花钱买了 AI 工具,但如果人不明确下令,它就屁事不干,这就是隐藏成本。你付了软件订阅费,还得搭上脑细胞去驱动每一次交互。

大多数中小企业部署了 Microsoft Copilot 或 ChatGPT 订阅版就等着奇迹发生。他们觉得 AI 会像个资深产品经理一样,能自动发现客户反馈里的趋势,或者在 Bug 爆发前发出预警。

但「响应式 AI」压根不是这么运作的。它就像个第一天上班的初级分析师:如果你不给它一个极其具体、范围明确的任务,它就只会盯着墙看。它没有自主性,不会主动去检查系统。

产品团队受这笔「税」的影响最深。产品管理说白了就是把混乱的信息综合起来。你的输入源来自 Zendesk、Gong 的通话转录、Slack 频道还有直接邮件。这些非结构化数据的量大得惊人。

当你的 AI 是响应式的,收集这些背景信息的重担就全落在你头上了。你得找数据、复制、粘贴到对话框,然后问对问题。在你动笔打字之前,你得先知道自己要找什么。

等你折腾完这些,你自己都能把 backlog 理清楚了。工具本该帮你省时间,但这种「调度成本」抵消了所有效率提升。你只是把「管理 backlog」变成了「管理提示词」。仅此而已。

为什么显而易见的解法行不通

这种解法之所以失败,是因为老板们总想强迫响应式 AI 去线性处理数据,完全忽略了「全局背景」的需求。当老板意识到「零主动权」税正在榨干产品团队时,通常会尝试用自动化来解决——搞一堆 Zapier 工作流,把 Zendesk 连到 OpenAI,再把 OpenAI 连到 Jira。

逻辑听起来没毛病:来了一个新客户工单,Zapier 触发 OpenAI 生成摘要,然后 Zapier 在 Jira 里建个新任务。我经常见到这种配置。

但实际情况是:Zapier 是线性处理数据的,一次触发一个动作。它没有全局视角,没法退后一步看全局。它只会盲目地对眼前的 webhook 做出反应。

如果一小时内有五个客户报告了同一个下单 Bug,Zapier 会运行五次。它会创建五个重复的 Jira 工单。它不知道这五件事是相关的。AI 只是默默地执行孤立的任务,然后用噪音塞满你的 backlog。它把一个小小的报告高峰变成了一场行政噩梦。

还有 Copilot 的路子。团队尝试用 Microsoft 365 里的 Copilot 来总结长邮件链。但 Copilot 受限于即时上下文窗口。你让它从 50 封邮件里找主题,它往往只会给你几个笼统的要点,漏掉技术细节,忽略边缘案例。

一个反直觉的事实是:针对背景信息缺失的问题,投喂更多的响应式 AI 只会让你的系统崩得更快。你需要的不是更聪明的模型,而是不同的触发机制。

你需要系统停止对单个事件做出反应。你需要它在你睡觉时,异步地阅读整个大局。依赖实时、单点触发,正是毁掉一个大好产品 backlog 的捷径。

真正奏效的方法

这套 n8n 架构利用 Claude 3.5 Sonnet 批量处理反馈,明早前就能将杂乱数据转化为产品决策。

真正奏效的方法是把「实时响应式提示词」换成一个「夜间运行的异步批处理引擎」。要解决这个问题,你必须从响应式工具转向主动式系统。你要搭建一个引擎,让它在早上把「决策方案」呈现在你面前。这有点像 OpenAI 为个人用户推出的 ChatGPT Pulse,但它是直接接入你公司业务的。

具体机制是这样的:停止对每一封邮件触发自动化。相反,搞批处理。

凌晨 3 点,一个 n8n 定时任务启动。它通过 API 抓取所有新的 Zendesk 工单、过去 24 小时的 Gong 通话转录,以及你当前活跃的 Jira backlog。它收集了你产品现状的完整上下文,一个数据点都不漏。

然后,n8n 工作流向 Claude 3.5 Sonnet 发起一次大规模的 API 调用。选 Claude 是因为它的上下文窗口处理大段文本非常出色,不会漏掉中间的细节。你给它一个严格的 JSON 模式(schema)。

你指示 Claude 对新反馈进行聚类,对比现有的 Jira 史诗任务,并输出一个结构化的 JSON 数组。输出必须包含:针对新问题的建议工单,或者根据新数据需要提升优先级的现有 Jira 工单 ID。

最后,n8n 解析这个 JSON。它不直接写入 Jira,而是在 Notion 或 Airtable 里生成一个清爽的审核仪表盘。

当你的产品经理在早上 8 点登录时,他们面对的不是闪烁的光标,而是一个仪表盘:「三位企业客户报告了下单 Bug。建议将 Jira Epic 402 提升至 P1 优先级。是否批准?」

他们点一下复选框,第二个 n8n webhook 就会执行最终的 Jira 更新。人类依然在环节中,但身份是「编辑」,而不是「写手」。

这套东西搭起来大概需要两到三周。成本在 £6k 到 £12k 之间,取决于你现在的 API 权限有多乱。第一个月就能回本。

主要的失败模式是「幻觉」。LLM 喜欢编造不存在的 Jira 工单 ID。解决办法是强迫 n8n 工作流在写入 Notion 之前,先去 Jira API 验证每个工单 ID。如果 ID 对不上,工作流就标记出来让人类审核。

哪里容易出问题

如果你的公司依赖于「没记在纸上」的内部经验(tribal knowledge),或者是非结构化的非文本数据,这种主动式架构就彻底玩不转了。这套方法威力巨大,但前提是需要干净、数字化的文本。如果输入的数据一团糟,系统就会卡死。你没法自动化一个依赖于「老员工脑子里那点东西」的流程。

如果你的销售团队拒绝用 Gong,只在 Pipedrive 里留下一堆模糊的语音笔记,AI 就没东西可读。如果你的用户反馈是扫描版 PDF,或者是没有文字的错误消息截图,错误率会从 1% 飙升到 ~15%。

在尝试搭建这套系统之前,你需要先对图像进行 OCR 识别,对音频进行转录。如果你直接把原始、无序的文件塞进批处理提示词,token 成本会激增,输出质量会下降。AI 会把所有的算力都花在解析乱码上,而不是分析产品主题。

你也没法用它来处理高度专业化的硬件调试。如果一个 Bug 需要读取堆栈跟踪(stack trace)、理解物理制造公差或解释私有的日志文件,LLM 会一本正经地瞎猜,然后搞错。

在花一分钱调 API 之前,先检查你的数据格式。如果你的团队主要靠没记录的电话和白板草图沟通,先整顿你的企业文化。AI 读不了你的心。

现在该做什么

你不需要明天就砸 £10k 来测试这个概念。这周你就可以用现有的工具,把产品团队从「响应式」转向「主动式」。

- 审计你的反馈渠道:打开你的 Zendesk 或共享支持邮箱。数数客户反馈到底落落在多少个不同的地方。如果超过三个,先合并它们。AI 需要一根干净、单一的管道来读取数据。

- 手动测试批处理提示词:在搭 n8n 工作流之前,先人工试一下。在冲刺(sprint)结束时,把每周的支持工单导出为 CSV。上传到 ChatGPT 或 Claude。让它对问题进行聚类,并对应到你当前的冲刺目标上。看看输出的东西到底有没有用。

- 限制你的 Zapier 触发器:如果你现在正用 Zapier 自动把邮件变成 Jira 工单,关掉它。把动作改为将摘要汇总到一个 Slack 频道或 Notion 页面。强迫人类在这些东西污染你的 backlog 之前进行批量审核。

- 尝试主动式设置:如果你能在手机上用 ChatGPT Pulse,打开它并连接你的 Google Workspace。观察它如何改变你的早间习惯。体验一下当 AI 在你提问之前就把答案带给你是什么感觉。这就是你公司业务应该达到的标准。

订阅获取 UK AI 洞察。

针对英国企业的 AI 实战内容 —— 拆解、教程、监管解读。随时取消。

随时取消。