你刚签了一份物流合同,准备把产品卖到法国和德国。运费锁定了,支付网关也调好了。现在,你的运营经理正盯着一份从 Shopify 导出的 4,000 个 SKU 的文件发愁:到底怎么才能在周末前把整个目录翻完?

人的第一直觉就是把所有东西复制粘贴到免费的网页翻译工具里。接着就有人发现,你的产品描述里到处都是成千上万的项目符号、加粗标签和超链接结构。你这才意识到,这根本不是语言问题,而是数据管线(data pipeline)的问题。

你需要一种程序化的方法,在不破坏排版的前提下,把英文电商数据变成德文和法文数据。这事儿有两个重量级选手:DeepL Pro 和 Google Cloud Translation API。但选对引擎只是成功了一半。

「标记语言翻译税」

所谓「标记语言翻译税」,是指你用基础 AI 工具翻译完产品目录后,不得不花人工去手动修复那些损坏的 HTML 标签和格式错误,这背后隐藏着巨大的运营成本。

每个电商平台都把产品描述存储为 HTML。当你的文案在 Shopify 里加粗某个功能或添加列表时,数据库保存的是 <strong> 和 <ul> 标签。如果你直接把这些原始数据塞进普通的消费级翻译工具,它压根不知道这些标签是什么意思。

它要么把英文标签翻译成字面意思的德语单词,要么干脆把标签全删了。结果就是一团糟。你原本排版精美的产品页面,到了德国站就成了一大块根本没法读的文字。

然后,你的财务助理得花三周时间手动把加粗、列表和超链接一个个加回去。他们只能靠猜,因为他们根本不会德语。他们得对照着英文网站,找到第三个列表项,然后试着把它对齐到德文文本块里的第三句话。这就是「标记语言翻译税」。

每个想省钱做网站本地化的中小企业都会踩这个坑。这事儿之所以一直存在,是因为老板们觉得翻译就是简单的「文字进、文字出」。他们完全无视了结构层。

你花 £30,000 的年薪雇个人在那儿做数据录入,而这些活儿只要配置好机器翻译 API 就能原生搞定。当你扩张到全欧洲时,文本量会成倍增长。

4,000 个 SKU 翻译成三种新语言,就是 12,000 条描述。你不可能靠人力去硬扛格式检查。你需要一个既能翻译文字,又能尊重代码的系统。

为什么那些「显而易见的办法」行不通

大多数中小企业会尝试用 Zapier 直接连到 ChatGPT API,或者装一个每月 £15 的通用型 Shopify 翻译插件。

逻辑听起来挺顺:你有 ChatGPT Plus 订阅,它法语说得溜极了,干嘛不直接让它翻产品描述?

现实情况是:大语言模型(LLM)是生成式的。它们的设计初衷是预测下一个词,要有创造力。如果你让 LLM 翻译一件防水夹克的技术描述,它会试着去「优化」文案。

它会发明新的形容词,会幻觉出一些你夹克压根没有的功能。在产品数据库里,你不需要创造力。你需要的是精确、高保真的机器翻译。

根据我的经验,靠简单的 Zapier 流程把文本推给 OpenAI 进行批量翻译,幻觉率在 5% 到 10% 之间。当你翻译 4,000 个产品时,意味着有 400 个列表里包含编造的信息。

如果柏林的一个客户因为 AI 幻觉出了 "Gore-Tex" 这个词而买了件夹克,这退货费你得掏。而且你还没在海外市场站稳脚跟,品牌名声就先毁了。

那些通用的 Shopify 插件也一样烂。它们底层用的是最便宜的路由,而且不让你设置自定义的品牌词库(glossary)。

如果你的品牌把桨板称为 "Drop Stitch"(拉丝工艺),通用插件会把它直译成法语。你那些专业性极强的运动器材瞬间听起来像个缝纫包,让买家一头雾水。

你需要的是专业的机器翻译引擎。DeepL Pro 和 Google Cloud Translation API 就是干这个的。它们是确定性的,不会胡编乱造。

但光买这些 API 的访问权限还不够。如果你只是把原始文本扔进它们的标准接口而不配置数据载体(payload),你还是会遇到格式崩溃的问题。你必须使用它们的高级功能。

真正管用的方法

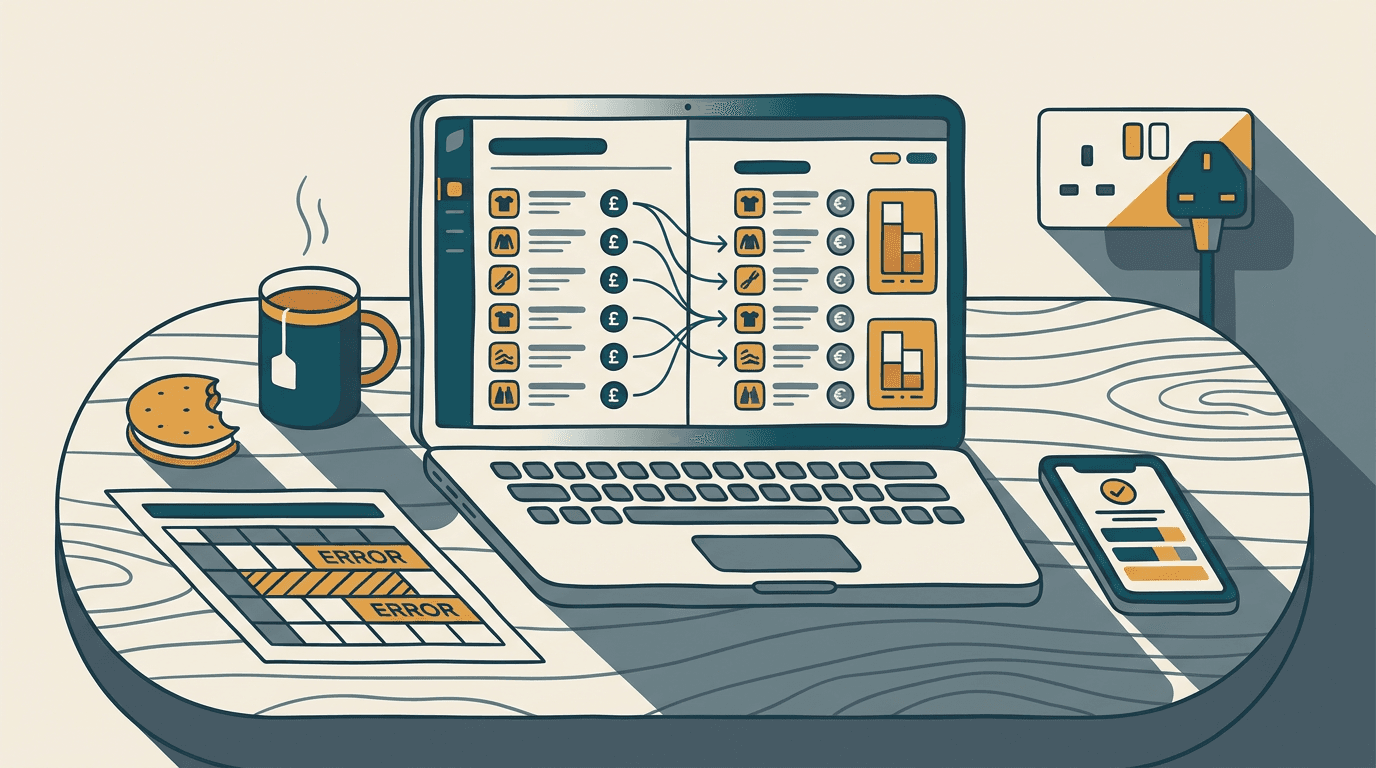

Shopify 订单通过 Make 传给 DeepL API,并利用参数精准处理 HTML 标签。

本地化目录的正确姿势是构建一个中间件管线:提取数据、保护 HTML、应用品牌词库,最后同步回去。

我建议用 Make 来编排这一切。Make 从你的 Shopify 店铺抓取产品 JSON 数据,里面包含标题、HTML 描述和元数据。然后 Make 把这些数据路由到 DeepL API Pro。

DeepL Pro 是处理欧洲语言的顶级引擎。它的基础费用是每月 $5.49,外加每百万字符 $25。对于这种规模的中小企业目录,你的 API 成本不到 £100。

DeepL 有一个专门处理标记语言的参数。在 API 调用中,你设置 tag_handling="html"。这会告诉引擎:翻译文字,但把 HTML 标签留在原地。<strong> 标签会自动包裹住翻译后对应的词。

你还要部署一个自定义词库。把包含锁定品牌词的 CSV 文件上传到 DeepL。如果你卖的是 "Navy Blue"(藏青色)靴子,词库会强制 API 使用特定的行业译法,而不是字面直译。

Make 会把词库 ID 连同 HTML 数据一起发送,还会指定源语言和目标语言,省得 API 去猜。DeepL 处理完请求后,会返回格式完美、翻译准确的 HTML。

最后,Make 使用 HTTP PATCH 请求通过 GraphQL API 更新 Shopify 产品,把新语言直接塞进你的欧洲站点。

这笔账很好算。DeepL 自己的 Forrester 研究显示,使用其高级 API 的全球企业投资回报率(ROI)高达 345% [来源](https://www.deepl.com/en/blog/forrester-tei-study-roi)。对于中小企业来说,这套系统搭建需要 1-2 周。根据你目前 Shopify 数据的混乱程度,自动化搭建的费用预计在 £4k-£8k 之间。

这里主要的失败点是原始数据太脏。如果你的英文描述里本来就有破损的 HTML 标签(比如随手复制粘贴漏掉了一个闭合的 </div>),API 就没法解析。

你可以在 Make 里加一个错误处理分支来解决。如果 DeepL 返回 400 错误,Make 就把那个特定的 SKU 扔进 Slack 频道让人工审核,而目录的其他部分继续翻译。

哪里会出问题

这套 DeepL 管线在进军法国、德国、西班牙和意大利时极其有效。但它也有局限性。

如果你要扩张到中东或亚洲,DeepL 就不是首选了。DeepL 的训练数据重度集中在欧洲语言。

对于阿拉伯语、日语或韩语,Google Cloud Translation API Advanced 是更好的引擎。Google 每百万字符收费 $20,而且原生支持从右向左的排版。它支持一百多种语言,而 DeepL 的选择要少得多。

这种方法在处理用户生成内容(UGC)时也会失灵。如果你试着用严格的词库和 HTML 解析器去跑成千上万条客户评论,那就搞砸了。

评论里全是错别字、俚语和表情符号。DeepL 会试着让它们听起来很专业,这反而破坏了评论的真实感。Google Cloud Translation API 在处理这种原始、混乱的文本时表现好得多,不会过度纠偏。

最后,如果你的原始产品数据存在老旧的 ERP 系统里,导出的描述只是没有任何结构的纯文本文件,那 API 也救不了你。在自动化生成德文数据之前,你得先结构化你的英文数据。

问题不在于你该不该翻译网站,而在于你是在构建一个可以规模化的系统,还是在构建一个需要人工检查每一段话的系统。在免费网页工具里点点按钮看着像是在干活,直到明天早上你得更新整个冬季产品线的三个语言版本时,你才会发现那是个坑。一个配置良好的 API 管线能扫清欧洲扩张的障碍。它把翻译从一个巨大的运营头疼事,变成了一个安静的后台进程。你不用再担心加粗标签坏了或者品牌名翻错了,你可以把精力放在真正的物流和跨境业务上。

订阅获取 UK AI 洞察。

针对英国企业的 AI 实战内容 —— 拆解、教程、监管解读。随时取消。

随时取消。