你坐在桌前喝着早咖啡,打开 LinkedIn,发现动态里全是被 AI 生成的超现实视频刷屏了。一只金毛寻回犬走在霓虹闪烁的东京街头;一段富有电影感的无人机航拍,掠过崎岖的海岸线。OpenAI 刚刚向 ChatGPT Plus 用户开放了 Sora [来源](https://openai.com/blog/sora-availability)。

你的营销总监给你转发了链接,还顺带发了条消息。她问,是不是终于可以取消那个每月 £3,000 的自由职业摄像师服务了?看起来,那些昂贵的拍摄、踩点和没完没了的后期延误终于要到头了。

你飞快地回了条消息,感觉自己给第三季度的营销活动找了个巨大的捷径。你甚至已经开始想象一夜之间砍掉大半内容创作成本的画面。但现实情况,其实要乱得多。

「从提示词到成品」的鸿沟

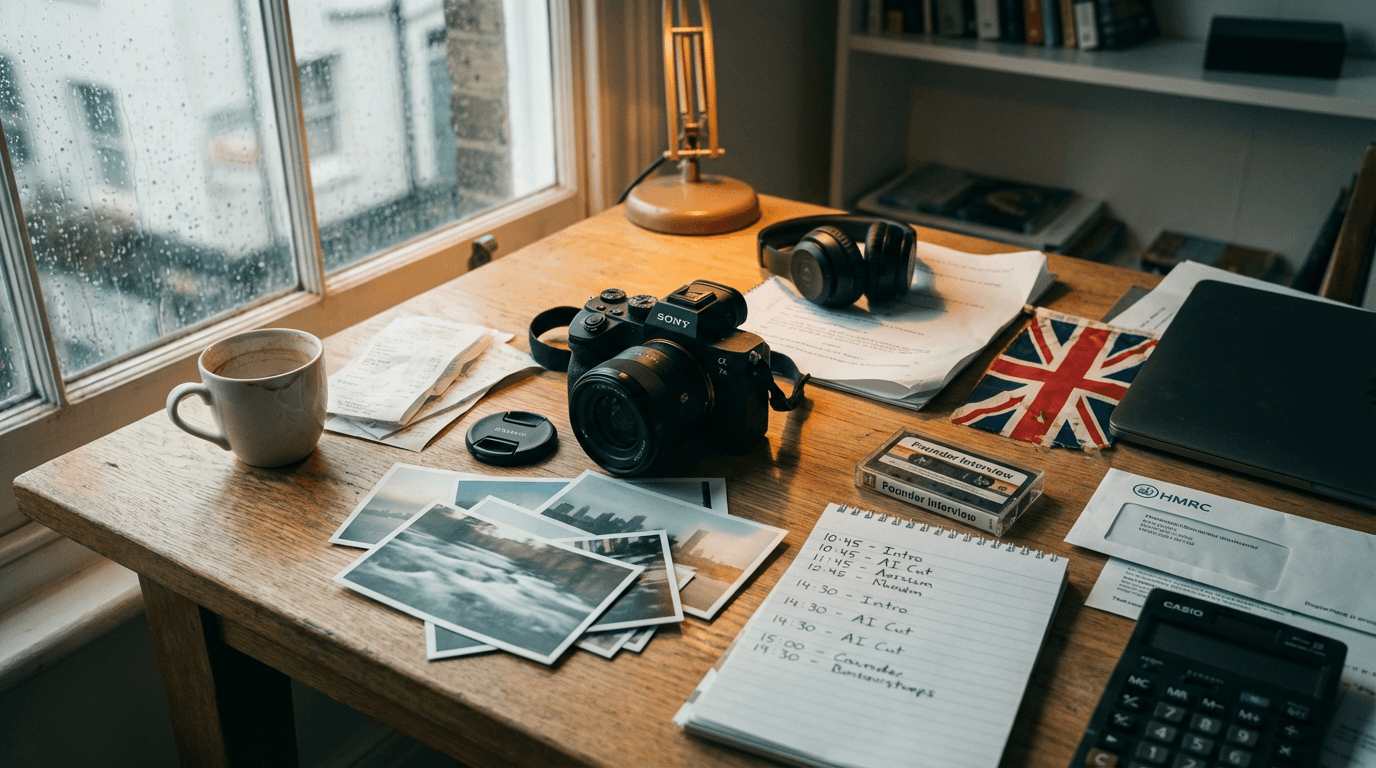

所谓「从提示词到成品」的鸿沟,是指把一段 AI 生成的原始素材变成真正能卖货的营销资产时,背后隐藏的大量人力成本。你在界面里输入一段提示词,生成了一段看起来很棒的视频:木桌上的一杯咖啡正冒着热气。乍一看,简直完美。

但你仔细一看,发现杯子的形状不对。热气居然是往回飘的。陶瓷杯上也没有公司的 Logo。你没法直接把这个原始文件扔进 Facebook 广告组里,还指望它能带来转化。原始素材只占了全部工作的 10%。

营销团队总觉得 AI 能取代整个创意供应链。其实不能。它只取代了摄像机和物理场地。你还是需要剪辑师来切片,需要调色师来对色,需要音效师加音效,还需要文案来写旁白脚本。

如果算上这些额外的人力,生成式 AI 在生产中的隐藏成本高得惊人 [来源](https://www.marketingweek.com/generative-ai-video-production-costs-2025/)。中小企业老板总觉得营销预算能立刻减半,结果到头来,花的钱一分没少。

预算只是被重新分配了。你不再给摄像师发工资,转而开始给提示词工程师和后期剪辑发工资,让他们去修补 AI 的「幻觉」。省下的那点钱全被这个鸿沟吞掉了。你只是把实地拍摄的成本,换成了无休止的数字修改成本。

为什么只买个 ChatGPT 账号根本没用

给初级营销主管买个 ChatGPT Plus 账号就想搞定视频,这事儿压根跑不通。因为生成式 AI 缺乏品牌一致性所必需的「确定性控制」。大多数中小企业老板都会先试这条路:买个订阅号,扔给员工,说「给我弄个 30 秒的宣传片」。你觉得周末前就能拿到成品。

结果肯定搞砸。因为像 Sora 这样的模型根本不懂「物体恒常性」。你想要一个镜头:一个女性在现代办公室里用笔记本电脑跑你的软件。AI 给了你一个电影感十足的漂亮片段。然后你需要第二个镜头:同一个女性对着镜头微笑。

模型给你生成了一个完全不同的人。光线从温暖的晨光变成了刺眼的办公室日光灯。笔记本电脑变成了一个长得像吐司机的怪胎。

当你的主角每隔三秒就变一张脸时,你根本没法建立连贯的品牌叙事。我反复看到的模式很清晰:强迫 AI 视频模型像传统电影片场那样工作,纯属浪费时间。

根据我的经验,你的初级员工会花 40 个小时在那儿调提示词,就为了弄出一个匹配的镜头。他们会加负面提示词,调随机种子,翻遍 Reddit 论坛找偏方。他们是在强迫这个工具去做它最不擅长的事。

这 40 个小时的工资,就烧在了一个人类摄像师 10 分钟就能拍好的任务上。这个工具的设计初衷是「无限变化」,而不是「严格连续」。当你跟模型的底层架构对着干时,你必输无疑。

最后你只会得到一文件夹互不相干、看着有点诡异的片段。然后你的团队试图在 Premiere Pro 里把它们缝合在一起,用厚重的文字遮盖和快速剪辑来掩盖错误。成品看起来廉价、脱节,而且极其不专业。

搭建「混合视频流水线」

这种混合模式用 AI 渲染氛围背景,而核心产品信息和品牌调性则坚持真人实拍。

对中小企业来说,唯一行得通的 AI 视频方案是:把生成式模型当成「素材库」,而不是「导演」。你不要让 AI 生成整个广告,而是用它来填补那些由真人拍摄的核心素材之间的视觉空白。

一个实际可行的流水线是这样的:首先,用高质量摄像机拍摄你的创始人或产品。这是你的「核心素材(Hero Footage)」。它能保证绝对的品牌准确度、正确的光影和真实的人类情感。

接着,列出你需要的空镜(B-roll)。你需要一个伦敦忙碌街头的镜头,一个时钟滴答走的特写,一段抽象的数据可视化。与其去买昂贵的素材库订阅,不如用 OpenAI Sora 生成这些特定的、孤立的片段。

你直接把 Sora 生成的原始片段拉进 Adobe Premiere Pro。因为这些是背景元素,角色的一致性并不重要。观众在切镜前只会看它们两秒钟。

你甚至可以把空镜的提示词生成自动化。用一个 n8n 的 webhook 盯着你的 Notion 分镜数据库。当一个场景被标记为「就绪」时,它会触发一个 Claude API 调用,按照严格的 JSON 格式写出优化过的 Sora 提示词,然后把提示词直接填回 Notion 卡片里。

至于音频,把脚本跑一遍 ElevenLabs 生成一个草稿旁白。这能让剪辑师根据视觉效果完美地控制视频节奏。只有在剪辑定稿后,你才需要付钱给真人配音员录制最终版。

这样的操作流程紧凑且可预测。剪辑师从 Google Workspace 拿核心素材,把 Sora 生成的空镜扔进时间轴,用 Frame.io 跟营销总监过初稿。评审的重点在于节奏,而不是去修补 AI 的低级错误。

搭建这套混合工作流大约需要两周的流程梳理和培训。根据你现有的技术栈,软件授权、API 额度和初始剪辑培训的成本大约在 £3,000 到 £5,000 之间。

这里最常见的失败模式是「过度生成」。你的团队会被 AI 的新鲜感带跑偏,生成了 500 个根本用不上的片段。要解决这个问题,必须强制执行:在任何人打开提示词界面之前,必须先有书面的分镜脚本。如果分镜上没有这个镜头,就不许生成。

什么时候必须坚持实拍?

如果你的产品需要极其精确的视觉呈现来防止退货,那么生成式视频会彻底崩盘。这种混合方法不是万能的。在投入任何 AI 视频工作流之前,你得先看看你的产品类别。

比如一家卖特定剪裁防水夹克的服装零售商。AI 不知道接缝的精确位置,不知道那层深蓝色到底是什么色号,更没法预测那种专利面料在模特走路时会怎么折叠。

它会完全幻觉出这些细节。夹克在每一帧里看起来都不太一样。当客户根据视频下单,收到的实物却长得不一样时,你的退货率会飙升。

同样的道理也适用于复杂的机械、软件界面或建筑图纸。如果产品的「视觉真实性」是核心卖点,你必须用真相机。生成式工具是用来搞氛围、搞语境、搞背景质感的,它们不是产品摄影师。

在你取消下一次拍摄之前,先看看你的分镜脚本。如果核心信息依赖于向客户展示他们邮包里到底会收到什么,那就继续开机拍摄。

急着靠生成式视频砍成本,本质上是对营销资产构建方式的误解。你付钱给制作公司,不只是为了让他们把镜头对准某个物体。你付的是叙事控制力、品牌一致性,以及把原始媒介转化为说服力的那套复杂操作。把一个强大的 AI 工具扔给一个没受过训练的团队,并不能消除这些麻烦。它只是把瓶颈从片场转移到了剪辑室。「从提示词到成品」的鸿沟,才是真实的商业成本。问题不在于 AI 能不能生成一段东京街头小狗的超现实视频,而在于你是否清楚地知道,你的创意流水线中哪些部分真正需要「人类的审美」——因为那是唯一能让你品牌脱颖而出的东西。

订阅获取 UK AI 洞察。

针对英国企业的 AI 实战内容 —— 拆解、教程、监管解读。随时取消。

随时取消。