应对英国-欧盟跨境贸易中的“影子加工者”责任风险

你的销售总监转发了一封邮件,发件人是你最大的意大利分销商。对方问你要一份「AI 处理增补协议」(AI processing addendum)。你压根儿没有这玩意。你平时用 ChatGPT 写报价单,用 Zapier 把潜在客户信息塞进 Pipedrive。你们公司上下 40 号人,都在利兹(Leeds)搞工程,谁也没想到去年 10 月罗马通过的一项当地法律,居然能管到你们头上。

但它确实管得着。你现在正手忙脚乱地排查,到底哪些云服务器读取了你欧洲客户的数据。你查了 OpenAI 的条款,又翻了 HubSpot 的声明。最后你发现,数据一旦离开收件箱,你根本不知道它去了哪儿。一团乱麻,还没人说得清为什么。就这么回事。

影子处理器的法律责任

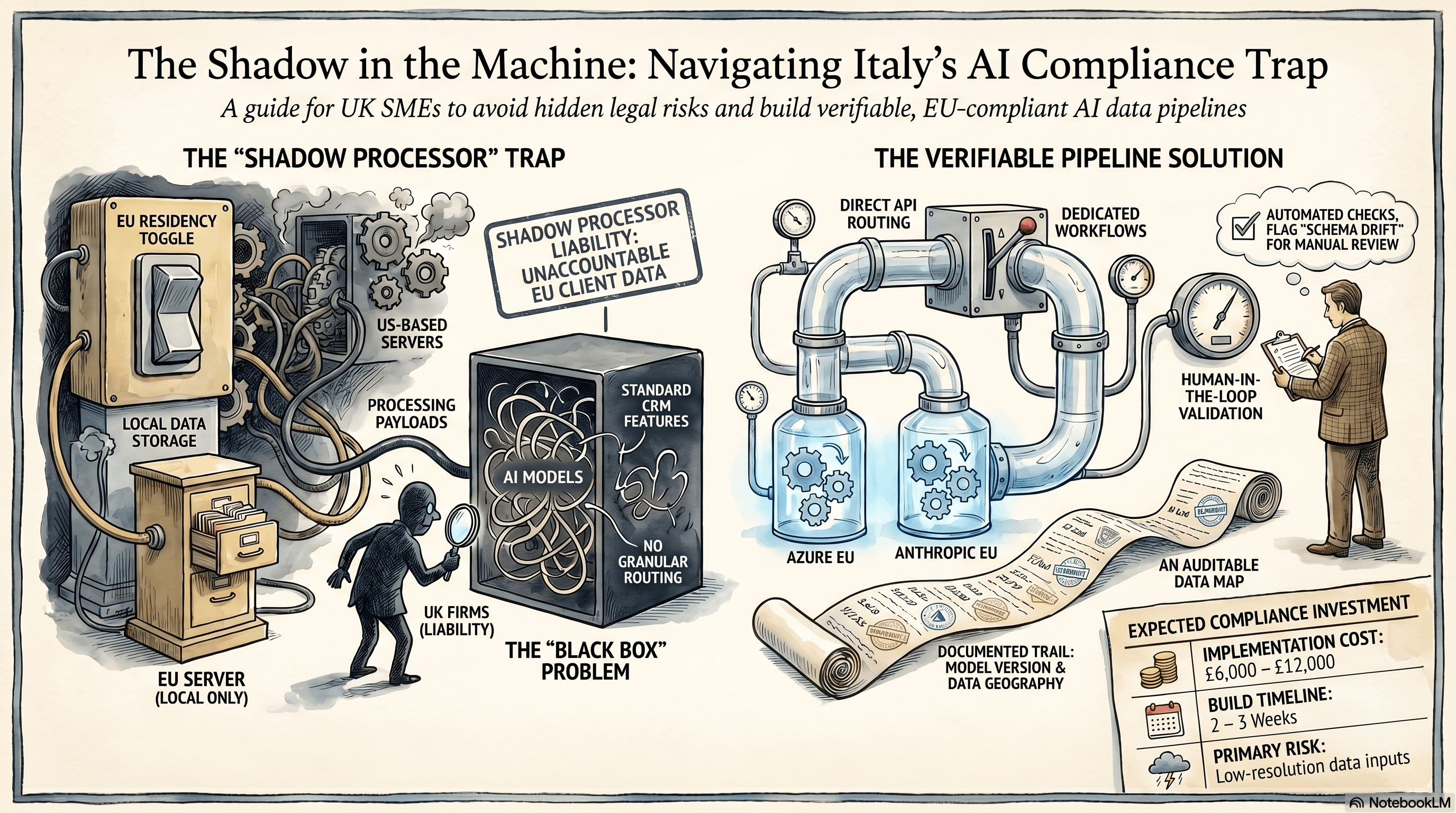

英国公司若通过未审计的美国 SaaS 处理意大利客户数据,将面临第三方 AI 违规的连带法律责任。

所谓「影子处理器责任」(shadow processor liability),是指英国企业面临的一种法律和财务风险:你日常用的 SaaS 工具,在处理欧洲客户数据时,背地里跑的是那些你根本没备案过的 AI 模型。

你付钱订购了一款软件。这款软件底层调用了一个语言模型。你处理了一份来自米兰客户的标准采购订单。现在,那个隐藏模型如何处理这些商业数据,法律责任全在你身上。

意大利 2025 年 10 月出台的《AI 治理框架》把这种情况定性为合规问题 来源。它强制要求任何与意大利公司打交道的供应商,必须准确记录哪些 AI 系统接触了业务。你想拿「不知情」当借口?没门。

这对英国中小企业打击很大,因为这涉及跨境贸易。你可能觉得你只是个本地供应商。但如果你的零件进入了意大利的供应链,或者你向意大利用户销售数字服务,你就掉进了他们的隐私监管网。

问题之所以一直存在,是因为这些工具让处理过程变得「不可见」。当你的运营经理在 Notion 里点一下「总结」,或者让 HubSpot 代写一封回信时,系统不会弹出合规警告。数据就这么悄无声息地离开了你的受控环境。

你是「数据控制者」。意大利监管机构才不管这功能是 Zapier 还是 Microsoft 开发的。他们在乎的是,你用了这个功能处理他们公民的数据,却没留下任何可追踪的治理记录。罚款是动真格的,客户信任的流失更是立竿见影。

为什么供应商的「合规开关」是个陷阱

指望 SaaS 供应商的「数据驻留」(data residency)开关是个陷阱,因为它只保护「静态数据」,管不到那些发往美国服务器进行处理的 API 负载。

面对意大利 AI 法,人的本能反应是去查软件设置。你登录 Make 或 Zapier,找到「欧盟数据驻留」开关,然后点亮它。你以为这样跨境贸易就合规了。

其实不然。实际情况是这样的:

那个开关只控制你的数据存在哪个数据库里。这意味着你的 Zapier 运行记录存到了法兰克福的服务器上。但是,当这个 Zapier 流程触发一个 OpenAI 步骤时,API 负载依然会横跨大西洋,飞向加利福尼亚的推理服务器。

数据是在欧盟境外处理的。影子处理器的责任,依然百分之百由你承担。

我经常看到这种套路。英国公司的创始人总觉得,既然买的是企业级软件,合规的事儿人家肯定帮我办好了。但供应商的服务条款里写得清清楚楚:API 数据传输的责任,得由你自己扛。

如果意大利审计员问你要 AI 处理流程图,你甩一张 Zapier 设置页面的截图是过不了关的。他们想知道的是:到底是哪个版本的模型处理了数据?推理是在哪儿发生的?数据有没有被拿去训练模型?

市面上现成的自动化工具回答不了这些问题。你 CRM 或客服系统里内置的 AI 步骤就是个「黑盒」。你控制不了 API 标头,也没法强行要求「零保留」政策。你只能把数据发出去,然后听天由命。

升级到 ChatGPT Team 订阅也解决不了问题。它确实能让 OpenAI 不用你的数据搞训练,但它没法提供新规要求的、精确到地区的路由控制。

搭建一个合规、可验证的流水线

n8n 架构图:数据经由欧盟 API 节点传输,确保管辖权受控且审计追踪可查。

保证合规的唯一办法,是把那些黑盒 SaaS 功能换成专用的流水线。在这里,API 标头和数据路由全由你说了算。

你需要证明,意大利客户的数据从进入收件箱的那一秒起,到底经历了什么。咱们来看一个真实案例:把意大利供应商发来的 PDF 处理进 Xero。

别用那种通用的 Zapier 邮件解析器,改用托管在欧盟服务器上的 n8n。n8n 的 Webhook 接收邮件并提取 PDF 附件。

接着,n8n 直接向 Claude 3.5 Sonnet 发起 API 调用。这是最关键的一步。因为你用的是原始 API,你可以强制执行严格的参数。你发送 PDF 时带着特定的 JSON 架构(schema),提取出发票号、细目和增值税金额。

更重要的是,你把这个 API 调用路由到 Anthropic 的欧盟端点,或者使用 Microsoft Azure 在欧盟托管的 OpenAI 模型。推理的地理位置由你控制。数据从未离开欧洲管辖区。

n8n 工作流接收 JSON 响应,根据你的架构进行验证,然后通过标准的 API POST 请求把干净的数据推送到 Xero。

这种方法给了你一条完整的、可审计的轨迹。如果意大利监管机构或谨慎的大客户问你要合规地图,你可以给他们看具体的 n8n 节点、API 端点,以及与模型提供商签署的零保留数据协议。

搭这么一套东西大概需要两到三周。预算大概在 £6,000 到 £12,000 之间,具体取决于你现在的收件箱规则有多乱,以及是否需要自定义 Xero 跟踪类别。

这里主要的失败点是「架构偏移」(schema drift)。AI 模型可能会凭空捏造一个字段名,或者供应商突然大改发票版式,导致视觉模型看懵了。

你可以在 n8n 里加一个验证步骤来解决。如果 JSON 输出跟你的 Xero 必填字段对不上,流程就自动停止。它会把发票发到 Slack 频道进行人工审核。它绝不会悄无声息地把烂数据写进你的账本。

本地处理的局限性

如果你的原始数据依赖于低分辨率扫描件,或者没有现代 API 的陈旧本地数据库,这种流水线方案就彻底玩不转了。

专用流水线非常高效,但在动手搭建之前,你得先检查原始数据的质量。

如果你的意大利客户全靠非结构化的 WhatsApp 语音留言沟通,或者发过来的送货单是手写的、扫描成了低分辨率的 TIFF 文件,这系统就瘫痪了。

语言模型是很厉害,但它没法在糟糕的输入上创造奇迹。如果你把模糊、压缩严重的扫描件塞进欧盟托管的视觉模型,你的错误率会从 1% 飙升到 12% 左右。

到那时候,Slack 里的手动审核频道就成了瓶颈。你团队花在纠正 AI 错误上的时间,比从头录入数据还要多。没错,这确实挺烦人的。

你还得检查内部的技术栈。如果你跑的是那种没有现代 REST API 的老古董本地 ERP 系统,要把提取的数据推回数据库,就得写专门的中间件。

这会让建设成本增加好几千英镑,工期也得拖长好几个月。在操心 AI 合规之前,先把你核心的数据存储和集成点搞定。别辛辛苦苦造了个完美的 AI 流水线,最后却把数据倒进了一个坏掉的数据库里。

值得思考的三个问题

整个欧洲的监管环境正在迅速收紧。你团队去年随手用起来的那些 SaaS 工具,到今年年底都会面临严苛的审计。好好审视一下你现在的业务流程:

- 如果你最大的欧洲客户要求你在 48 小时内,提供一份完整的、有据可查的 AI 系统地图(涵盖所有接触过他们商业数据的系统),你能准确拿出来吗?

- 你是不是一边依赖软件供应商那句笼统的「欧盟数据驻留」口号,一边却悄悄把原始文本发往美国的推理服务器进行处理?

- 当自动化数据提取遇到奇葩案例失败时,你的系统是会悄悄往财务软件里塞空字段,还是会标记出具体错误并交给人工审核?

数据合规不是让你彻底不用 AI,而是要控制底层的「管道」。把架构理顺,搞清楚数据流向,这些新规就会变成一道护城河,帮你把那些动作慢的竞争对手挡在外面。

订阅获取 UK AI 洞察。

针对英国企业的 AI 实战内容 —— 拆解、教程、监管解读。随时取消。

随时取消。