被动泄露的知识产权:为什么 LinkedIn AI 的默认设置正在掏空你中小企业的战略资产

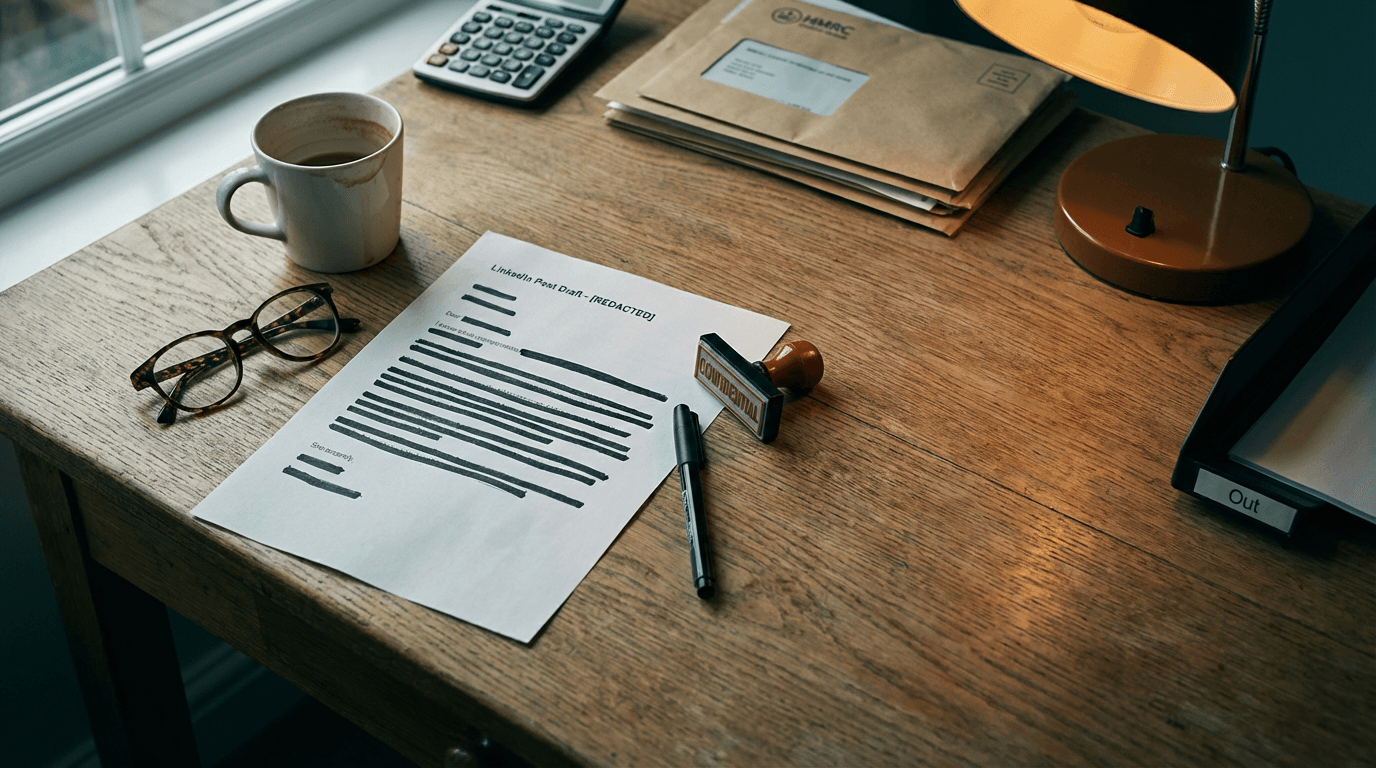

你的运营经理刚在 LinkedIn 上发了一篇干货满满的复盘。他们详细拆解了团队是如何把客户入驻流程缩短一半的,列出了具体的软件组合,还解释了首席开发人员花了三周才搞定的自定义解决方案。

他们点击了发布,心里挺自豪。他们觉得这是在打造个人品牌。

但实际情况是这样的:那篇帖子直接绕过了你们内部的安全协议,喂给了 Microsoft 的 AI 训练流水线。

从 2025 年底开始,LinkedIn 默认就会抓取用户数据来训练生成式 AI 模型,除非用户自己费劲地去翻设置项并手动关闭。

你的团队正在把你们公司的核心运营手册,免费送给一个公开的机器学习模型。而你,可能还在鼓励他们这么做。

被动的知识产权泄露

所谓的“被动知识产权泄露”,就是通过员工社交媒体的默认设置,把你公司的私有方法论持续、无管控地输送给公开 AI 模型。

这事儿发生得悄无声息。你不会收到大规模数据泄露的警报,也没有穿着连帽衫的黑客。这只是你最优秀的员工在做营销大师们教他们做的事:公开创作。他们分享手册、模板和运营经验,想以此吸引人才或客户。

但平台的规则变了。2025 年底,LinkedIn 更新了隐私政策,默认使用会员数据来训练其生成式 AI 模型(https://www.helpnetsecurity.com/2025/09/18/linkedin-ai-data-privacy/)。这包括帖子、文章和个人资料数据。如果你的团队在英国或欧盟工作,他们是自动被加入的(https://proton.me/blog/linkedin-ai-training-opt-out)。

对于中小企业来说,这是一个结构性问题。大企业有专利和庞大的法务团队来保护知识产权,但你没有。你的竞争优势就是你的流程。是你把 Xero、HubSpot 和自定义数据库串联起来,从而比大公司交付得更快的那个具体方法。

当你的团队发布了这些流程的细节,LinkedIn 的模型就会吸收它。Definition Consulting 指出了一个残酷的现实:使用 AI 工具的竞争对手,理论上现在可以直接从这些汇总数据中模仿你的品牌语调,或者提取你的市场策略(https://definitionconsulting.com/linkedin-algorithm-privacy-changes/)。

这种泄露之所以能持续,是因为它看起来像是在做营销。当员工发布深度运营内容时,创始人往往还会带头鼓掌。你奖励了互动率,却没意识到你正在为竞争对手明年要买的工具提供免费的训练数据。

为什么显而易见的解决方法没用

靠手写的 HR 政策和笼统的社交媒体指南是行不通的,因为你是在靠人工合规去对抗一个自动化的、平台级的数据摄取引擎。

大多数中小企业是怎么做的?开全员大会。HR 发全员邮件。内容很简单:“请进入你的 LinkedIn 设置,找到数据隐私,关掉‘用于生成式 AI 改进的数据’选项。”或者更糟,写一份 14 页的政策文件丢进 Google Workspace 共享盘,让每个人签字。

这就是为什么手动关闭注定会失败:

第一,LinkedIn 的用户界面经常变。开关的位置会动。一个初级分析师想去改设置,结果被 Slack 弹窗带跑了,然后就放弃了。

第二,就算今天每个员工都关掉了它,那也只能停止未来的数据收集。平台明确表示,退出操作不会撤回已经抓取和处理过的数据(https://proton.me/blog/linkedin-ai-training-opt-out)。

没错,这确实很恶心。

但更深层的失败在于“政策文件”这种思维。书面政策假设风险是名誉风险——担心员工说脏话或侮辱客户。这根本没搞懂现在的技术。现在的风险是算法层面的。

如果你想通过强制要求所有帖子必须经过 Buffer 或 HubSpot 这种排期工具来绕过这个问题,那你完全抓错药了。排期工具把文本推送到 LinkedIn 的 API。一旦 JSON 数据包到达 LinkedIn 的服务器,平台的隐私条款就会宣称这些文本归他们训练用了。

你没法靠政策来躲过平台级的数据抓取。我经常看到创始人觉得只要员工档案里有一份签了字的 PDF,他们的知识产权就安全了。那张纸挡不住网络爬虫。指望员工在他们工作的每个平台上手动管理隐私设置,这是一场必败的仗。只要你招个新人忘了点那个开关,防线就崩了。

真正有效的方法

自动化脱敏层:Make.com 拦截 Slack 草稿,由 Claude 隐去知识产权信息,最后交由人工审核。

保护运营数据的唯一可靠方法,是建立一个自动化的“脱敏层”,在文本传到网上之前,把私有的技术细节剥离掉。

你不用阻止团队发帖,而是拦截草稿。在一个有效的系统中,流程是这样的:

假设你的运营主管想发一篇关于最近战果的帖子。他们搞定了 Stripe、一个老旧的 3PL 供应商和 Xero 之间乱七八糟的对账自动化。原始草稿里包含了他们调用的具体 API 接口、他们绕过的具体 Zapier 限制,以及上个月处理的确切交易量。

如果直接发出去,知识产权就泄露了。

相反,他们把草稿丢进一个叫 #content-review 的专用 Slack 频道。这会触发 Make.com 里的一个 webhook。Make 场景抓取文本并发送给 Claude 3.5 Sonnet 的 API。

注意这一步。给 Claude 的系统提示词非常严格:“你是一个企业知识产权保护过滤器。审查以下 LinkedIn 帖子草稿。识别并脱敏具体的供应商名称、确切的收入数字、自定义代码引用和私有工作流步骤。重写帖子以保留核心的领导力洞察和语调,但将运营机制通用化。仅返回脱敏后的文本。”

Claude 处理草稿。它把“我们通过自定义的 Supabase edge function 路由 Stripe 的 JSON 数据,绕过了 Zapier 的 2 分钟超时限制,处理了 £2.4M 的交易量”改成了“我们重建了支付路由以异步处理大额交易,彻底消除了中间件超时问题。”

Make 场景接收 Claude 的输出,把它作为回复发回 Slack 频道,并艾特运营主管。

如果看起来不错,他们点一下绿色的“批准”按钮;如果 Claude 写得太像机器人,就点红色的“重新生成”。只有在点击批准后,Make.com 才会把最终文本推送到 LinkedIn API。

你可以用 Make 或 n8n 搭建整套流程。大概需要一到两周的搭建和测试时间。预计投入 £2,000 到 £4,000 的设置费用,加上每月不到 £10 到 £20 的 Claude 和 Make 的 API 成本。

这里主要的失败点是“过度脱敏”。AI 模型喜欢把人的棱角磨平。如果你不小心,每篇帖子读起来都像企业新闻稿。解决办法是保留“人工干预”。Slack 的审批步骤是强制性的。自动化负责知识产权脱敏的重活,但人保留编辑控制权。

这种方法在什么时候会失效

如果你的商业模式依赖于向客户展示极度具体的技术权威,那么这个自动化脱敏层就彻底玩不转了。

这种方法对通用运营、财务和销售团队非常有效。但如果你开的是一家定制工程咨询公司、精品网络安全公司或高度专业化的数据架构机构,那些具体的技术细节本身就是营销。

客户雇你正是因为你知道如何配置某个冷门的 AWS 实例,或者修补某个特定的零日漏洞。如果你把这些帖子丢进脱敏提示词,你就毁掉了它的价值。把“我们使用自定义 Rust 二进制文件修复了 CVE-2026-1234”泛化成“我们使用现代编程解决了安全问题”,会让你的专家看起来像个业余选手。

在搭建这套系统之前,你需要审计你的营销策略。如果你的销售漏斗依赖于证明你掌握某个具体的代码片段或财务模型,你就不能用自动脱敏。

你必须接受数据被摄取这件事,把它当作获客成本。你明知道模型在学习你的数据,但你知道眼前的获客价值超过了竞争对手抄你作业的长期风险。

三个值得深思的问题

数字曝光的规则在过去一年里发生了根本性的变化。你不再只是向潜在买家和新员工展示你的成绩,你还在主动喂养那些最终会为你竞争对手的工具提供动力的引擎。在你批准下一次内部动员、让团队去网上打造个人品牌之前,仔细看看那些正从你公司流出的具体信息。

- 你是否确切知道,你有哪些核心员工目前正处于 LinkedIn 的生成式 AI 训练数据抓取状态中?他们在这个季度发布了哪些具体的运营细节?

- 如果你最大的竞争对手让公开 AI 模型仅根据你团队过往的社交媒体帖子,来重构你们私有的客户入驻流程,生成的准确度会有多高?这有多危险?

- 你公司目前的社交媒体政策是否真的涉及了平台级 API 抓取的技术机制,还是说它仅仅是一份过时的 HR 文档,只负责告诉大家在网上要有礼貌?

订阅获取 UK AI 洞察。

针对英国企业的 AI 实战内容 —— 拆解、教程、监管解读。随时取消。

随时取消。