省下这 £50k 的投标成本:中小企业如何通过自动化搞定公共部门竞标

你正盯着一份来自地方议会的 140 页 PDF。截止日期还有九天。你的运营经理已经忙得不可开交,销售代表正忙着去签真正的单子。所以,作为创始人的你,只能牺牲周末时间,在 Excel 里苦哈哈地搭一个合规矩阵。

英国政府最近宣布了一项计划,到 2028 年要将 £3,410 亿采购支出中的 30% 直接拨给中小企业 [来源](https://committees.parliament.uk/work/8345/small-business-strategy/)。这是一笔巨大的资金池。但想要拿到这笔钱,你得玩一场死板的合规游戏。

你必须一字不差地回答五十个问题,还得把每一句话都对应到隐藏在附件里的评分权重上。如果你没有专门的投标团队,你基本上就被拒之门外了。

£50,000 的「投标税」

这 £50,000 的「投标税」是一项隐形成本。为了不因为技术细节被取消资格,你不得不雇专人来阅读、解析和格式化公共部门的招标文档。

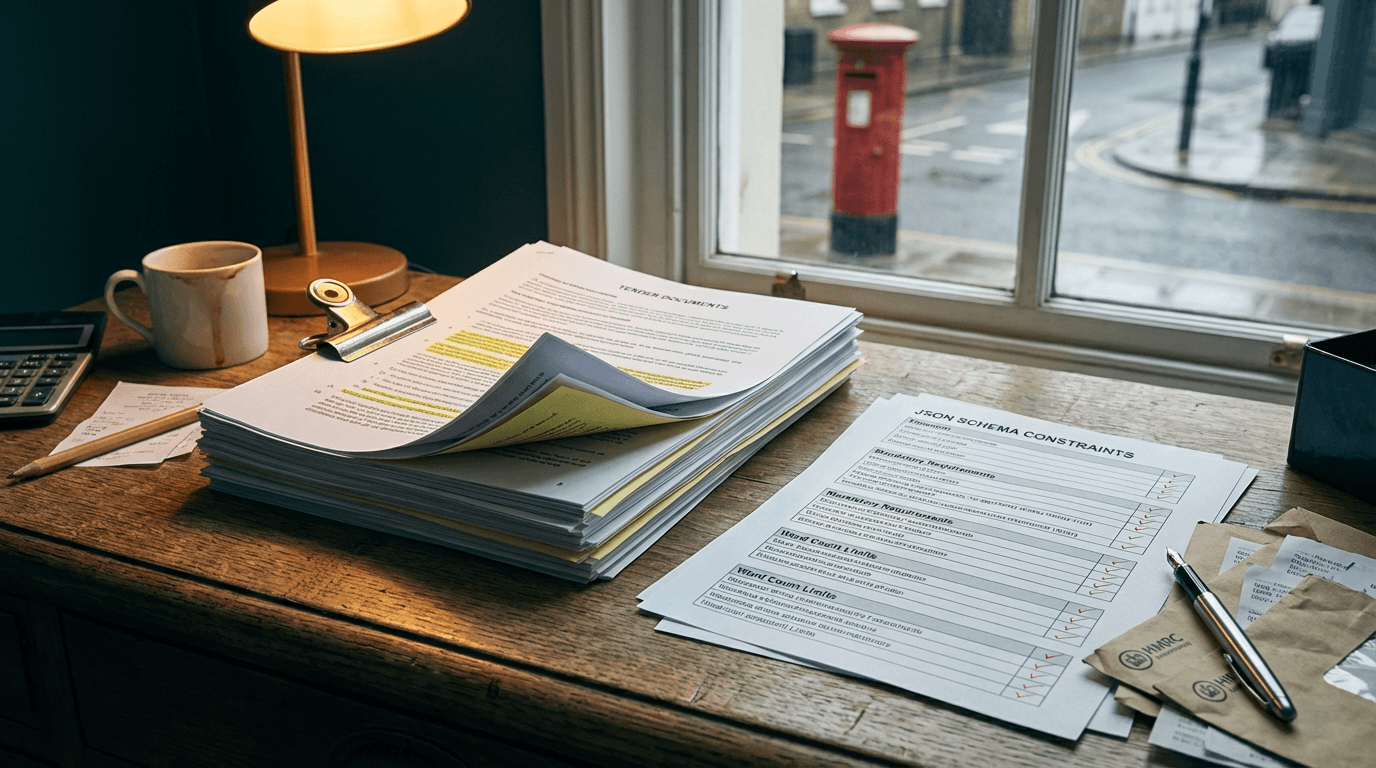

公共采购比的不是谁的服务最好,而是买家的一场风险规避练习。他们发布一份 200 页的招标邀请书(ITT),就指望你能从第 147 页里翻出那条强制性的保险限额要求。

大多数中小企业没法为了让人整天读 PDF,就每年掏 £50,000 雇个全职投标经理。所以这活儿就落到了管理层头上。你得读文档、划重点、标出违约条款,再手动列出所有强制要求。

这事儿搞得一团糟。没人知道为什么这些文档的格式能烂成那样。没辙。

因为手动操作太费劲,中小企业往往只能在极少数有把握的项目上投标。你登录门户网站,看到一份 50 页的规范书,直接就觉得不值得搭上整个周末。

如果申请过程的阻力一直这么大,政府那 30% 的中小企业目标就毫无意义。你能交付的合同和你精力能应付的投标合同之间,隔着的就是这笔「税」。你的机会成本正在流失,因为靠人工解析文档根本没法规模化。

为什么通用聊天机器人会搞砸

通用聊天机器人之所以不行,是因为大型语言模型(LLM)更看重叙事的流畅度,而不是严格的法律合规性。这会导致它们产生幻觉,或者漏掉强制性的评审标准。

人的第一反应通常是花 £25/月买个 ChatGPT Plus,把 PDF 往对话框里一扔,然后让它写标书。

千万别这么干。

当你把 100 页的公共部门标书喂给标准的 LLM 时,它会跟丢逻辑。它会胡编评审权重,漏掉隐藏的责任上限。为了输出一段听起来不错、语气自信的文字,它会抹平那些死板的法律约束。

这就是它出问题的具体机制:通用 LLM 使用的注意力机制会优先处理长提示词的开头和结尾。如果某个强制性的认证要求埋在厚厚的附件中间,模型会一声不吭地把它丢掉。

你提交了标书。结果在第一轮就因为不合规被刷掉了。

我经常见到这种情况。根据我的经验,把大份 PDF 扔进通用机器人只会导致彻底失败。AI 不会把你的回答和具体的条款进行交叉比对,它只会瞎写。

而且,这事儿挺烦人的。你最后花在核实 AI 输出内容上的时间,比你从头开始写还要多。

你不能指望把 Zapier 接入 OpenAI 就能赢下政府合同。Zapier 基础的文本提取功能会毁掉文档结构,让表格变成一堆没法读的乱码。

当你的评审标准藏在一个复杂的表格里时,自动化流程会静默地写入空值,而你只有在系统拒绝你的申请时才会发现。

很多中小企业尝试通过 Make 或 Zapier 路由采购门户的邮件,以此来自动化筛选阶段。他们设置了一个流程:当 Outlook 收到新的招标提醒时触发。

Webhook 剥离 PDF 附件,发给 OpenAI API,然后尝试把摘要扔进 Slack。这听起来很美好,但在现实面前不堪一击。

大文件会导致 API 超时。Token 限制会截断文档。你在 Slack 里拿到的只是个笼统的摘要,漏掉了最重要的细节:藏在细则里的那条不可计费成本条款。

法医级提取法

投标架构拆解:提取与撰写完全隔离,这才是防止 AI 胡说八道的关键。

「法医级提取法」是一种将招标约束条件的提取与标书撰写物理分离的方法。它使用严格的 JSON 模式(schemas)来防止 AI 瞎编。

要赢下这些标,你必须把「提取」和「撰写」分开。不要让 AI 去写标书。你要建立一个系统来审计标书,提取约束条件,然后根据这些约束条件生成对应的回答。

这就是你消除 £50,000「投标税」的方法。如果你做对了,流程应该是这样的:

你下载了一份 150 页的区域 IT 支持合同 ITT。你不用亲自读,而是把它跑一遍像 Lucius AI 这种专门为中小企业投标设计的法医级引擎 [来源](https://lucius.ai/sme-bid-writing)。或者,如果你想拥有自己的基础设施,可以自己搭一个流水线。

来看看怎么自建:你把 PDF 扔进指定的 Google Drive 文件夹。这会触发一个 n8n 工作流。n8n 的 Webhook 把文档发给一个能保留表格结构的文档解析器。

然后,n8n 调用 Claude 3.5 Sonnet 的 API。关键点在于:你要使用严格的 JSON 模式。不要问它要摘要,而是要求它输出一系列特定的对象:违约条款、强制认证和评审权重。

Webhook 解析 JSON 并将其直接写入 Airtable。现在你就有了一个合规矩阵。你过一遍,决定投标。

下一步是撰写。n8n 工作流从 Supabase 中调取你过去中标的标书。它把 Airtable 里的具体评审标准和这些素材一起喂给新的 Claude API 调用。

提示词会强制模型为它的每一个论点引用原始文档的确切条款。如果标书要求提供数据安全协议,AI 会写好回答并附上 [Part A §4]。

搭建这套 n8n、Supabase 和 Claude 流水线需要 2-3 周。根据你现有素材的整洁程度,预计花费在 £6,000 到 £12,000 之间。或者,像 Lucius AI 这种现成的工具,每次扫描大约只需 £49 就能搞定法医级提取。

这里主要的失败模式是「上下文注入」做得不好。如果你的 Supabase 向量数据库拿一个 £10,000 的私营部门项目案例,去回答一个 £500,000 的公共部门问题,那回答看起来会非常幼稚。

解决办法是强制 AI 为其引用的素材输出一个置信度分数。如果分数低于 80%,系统会在 Slack 里提醒人工审核。

哪里会掉链子

如果买家上传的是扫描的 TIFF 文件而不是机器可读的 PDF,或者你的公司缺乏可供 AI 模仿的过往素材库,这套系统就会失灵。

这套架构很强大,但不是魔法。在某些特定环境下它会哑火,你在花一分钱买 API 额度之前得先搞清楚。

如果你面对的买家是那种老掉牙的地方议会,他们的采购门户通常非常过时。有时候招标文档是扫描的 TIFF 图片,或者是复印得乱七八糟、还有手写修改的 PDF。

标准的文本提取在这里完全没戏。你需要先通过专门的 OCR 层处理文件,即便如此,错误率也会从 1% 飙升到 12% 左右。在 AI 能读懂之前,你得花好几个小时手动修正文本。

另外,这个系统需要一个「事实基础」。如果你的公司以前没写过什么东西,AI 就没法模仿。没有以前的标书,没有详细的方法论文档,没有技术架构图。

它写出来的东西会是空洞的废话。你没法在白纸上搞自动化。

如果你是第一次进入公共部门的中小企业,前几个标书你必须手动写。你需要建立自己的答案库。只有当你有了这个基准,你才能开始把它喂进 Airtable 和 Supabase,从而投更多的标。

留给你的三个问题

公共部门正在慢慢打开钱包。钱就在那儿,但准入门槛纯粹是运营上的摩擦。你要么雇一支昂贵的团队去读没完没了的 PDF,要么建一个系统帮你干这些重活儿。

在决定下一步怎么走之前,仔细看看你现在的投标流程。留意这几点:

- 你丢掉公共部门的标,是因为你的报价真的没有竞争力,还是因为你的人工合规映射做得太糙,漏掉了隐藏的评审标准?

- 你目前的 AI 配置是会自动把生成的答案与具体的招标条款进行交叉比对,还是只会写一些听起来很自信、但在审查下漏洞百出的段落?

- 如果政府真的实现了 30% 的中小企业采购目标,你是否有足够的运营带宽在不累垮管理层的情况下,在今年多投三倍的标?

订阅获取 UK AI 洞察。

针对英国企业的 AI 实战内容 —— 拆解、教程、监管解读。随时取消。

随时取消。