你正和你的运营经理坐在一起。她手里拿着一个文件夹,里面是 400 份没打码的供应商合同,上面全是价格阶梯和违约条款。你想把这些合同里的续约日期和 SLA 条款提取出来,存进 Notion 数据库。

你们心里都清楚,ChatGPT 十分钟就能搞定这事儿。

但你也知道,把这些 PDF 往浏览器里一贴,你公司的底价结构就全传到加利福尼亚的服务器上去了。所以她只能手动录入。这活儿干了整整三周。

这就是目前英国中小企业面对 AI 的现状:要么图快但数据全裸,要么为了安全慢得要死。你想要顶尖模型的推理能力,但合规要求又逼着你只能用离线表格。这听起来像是个死结。

API 泄露天花板

所谓的 API 泄露天花板,是一道硬门槛。当你最核心、最值钱的业务数据因为太敏感而不敢发给第三方云端模型时,你的自动化之路就到头了。你先搞定了那些简单的活儿:用 Zapier 自动写营销文案,用 Claude 总结普通的销售电话。你让 AI 碰的都是业务的皮毛。

但也仅限于此。

一旦涉及到核心业务,自动化就停摆了。你不能把病历发给 OpenAI,不能把没打码的并购意向书塞进某个随处可见的 SaaS 套壳工具,更不能把原始工资单数据喂给公共 API。风险太大了。你有 GDPR 的法律约束,有严格的客户保密协议,或者你单纯就是不想把自家的私有数据送给别人去训练模型。

为什么这局面一直破不了?因为大多数老板觉得本地 AI 都是玩具。他们觉得跑私有模型,要么得忍受笔记本电脑上那个满嘴胡吣的笨蛋机器人,要么得花 £400,000 买一架 Nvidia 服务器,还得配专门的冷却系统 and 三个 Linux 工程师来伺候。他们看着企业级 AI 市场,满眼都是巨大的数据中心,于是理所当然地认为:没那个规模就玩不转。

所以你接受了这个天花板。你付钱让员工去做最枯燥、最重复的工作,仅仅是因为人类能签署保密协议(NDA)。你把你最贵的人才困在数据录入这种活儿上,因为数据太值钱,绝不能离开本地网络。你的业务规模只能靠堆人头线性增长,而那些对数据隐私没那么讲究的竞争对手,正靠着高利润率把你甩在身后。

为什么那些“显而易见”的方案行不通

想搞本地 AI,常规路子基本都会失败。因为中小企业的单机配置根本没有足够的内存带宽来运行像样的模型。当老板们试图冲破 API 泄露天花板时,通常会犯两个错误。

第一,买个企业级 AI SaaS 工具。 你按每个账号 £50 的价格买个仪表盘,对方承诺有银行级安全。但你盯着网络请求看看。剥开外壳,这工具其实就是把你的提示词包进一个 JSON 载体,然后发给 OpenAI 或 Anthropic。没错,供应商声称他们不会用 API 数据进行训练。但你的原始数据还是离开了你的网络,跨过了公共互联网,存在了第三方的服务器上。如果你做的是医疗、金融或法律服务,这就是个随时会爆雷的合规漏洞。你只是把数据泄露的风险外包了而已。

第二,尝试在单机上跑本地模型。 你在 M2 MacBook Pro 上下载了 Ollama,加载了一个 80 亿参数的小模型,然后让它解析一份 50 页的法律 PDF。

根据我的经验,老板们会浪费 40 到 50 个小时,试图强迫一个 80 亿参数的模型去干 1200 亿参数模型才能干的活儿。结果呢?它吐出来的全是胡言乱语。它会幻构出根本不存在的条款,读到后半部分时已经把前半部分忘光了。

这是大多数人没搞懂的硬件逻辑:大语言模型的瓶颈不在算力,而在内存带宽。要达到 GPT-4 级别的推理水平,你需要 1000 亿参数以上的模型。这种规模的模型光是加载进内存就需要大约 80GB 的 RAM,而且需要极高的带宽才能以人类阅读的速度生成文本。

单台高端机器会撞上硬件墙。Zapier 帮不了你。一台顶配的 Mac Studio 带宽确实惊人,但统一内存上限也就 192GB。对于顶级模型加上海量的上下文窗口来说,这空间根本不够。模型要么干脆加载不出来,要么溢出到交换内存里,速度慢到一分钟蹦一个词。系统崩了,因为它被“饿”死了。

真正管用的方案

四台 Mac Studio 通过 Thunderbolt 5 串联,共享内存来本地跑 100B+ 超大模型。

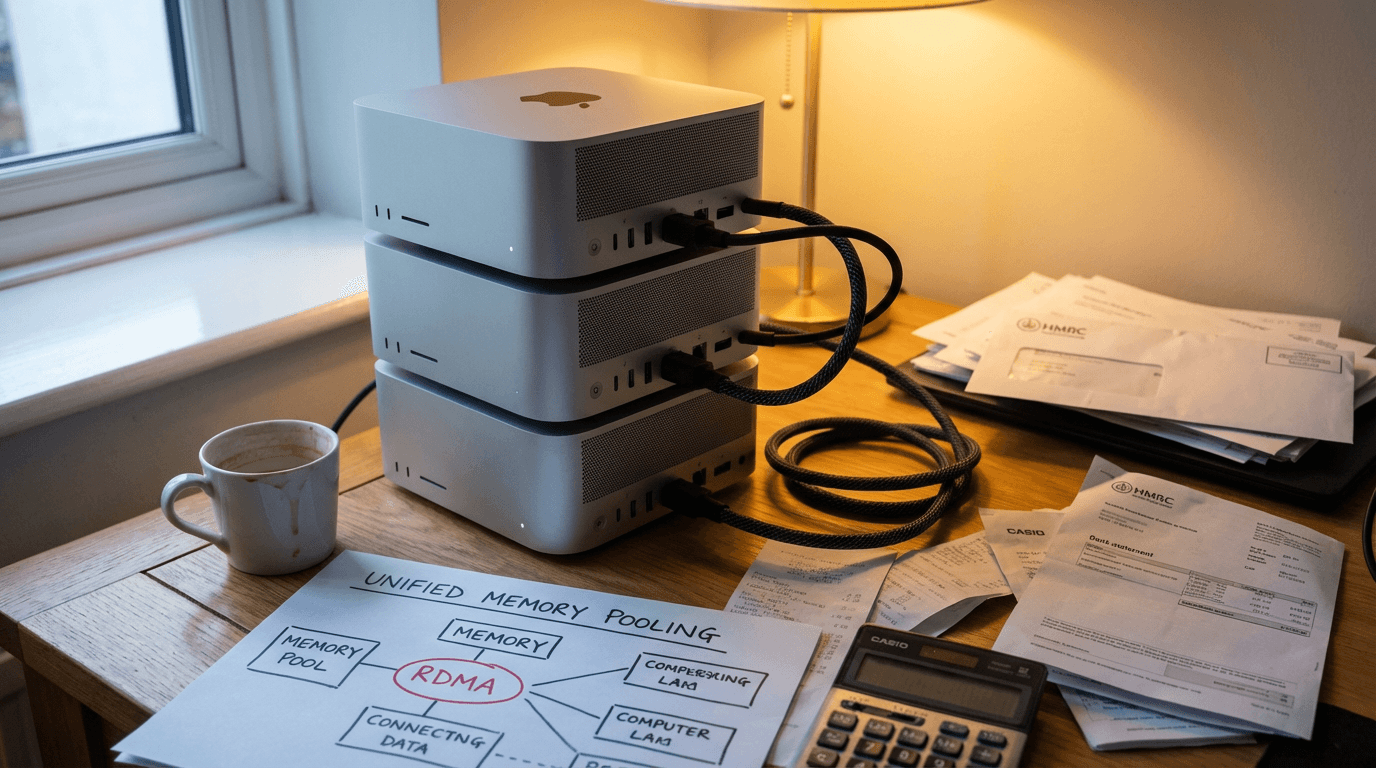

方案就是:利用 Thunderbolt 5 的 RDMA 技术,把几台 Mac Studio 串联起来,组成一个统一内存池的私有 AI 服务器。

2025 年 12 月,苹果发布了 macOS Tahoe 26.2 来源。它悄悄引入了基于 Thunderbolt 5 的远程直接内存访问(RDMA)。这彻底改变了本地 AI 的物理规则。

标准的网络连接用的是 TCP/IP。CPU 必须打包、发送、接收并拆包每一个字节,这会产生延迟。而 RDMA 允许一台 Mac 直接读取另一台 Mac 的内存,完全绕过 CPU。延迟降到了微秒级。

具体配置如下:买四台 M3 Ultra 芯片的 Mac Studio。用标准的 2 米 Thunderbolt 5 线缆把它们连成环形拓扑。安装苹果的 MLX 框架和开源的 EXO 1.0 编排层。

现在,你拥有了一台统一的 AI 超级计算机。它有 768GB 的统一内存,节点间带宽达 80 Gbps。它的表现完全像一台巨型企业服务器,但它只是安静地待在桌子上。

这是一个真实的业务流:你的财务邮箱收到一封邮件,附件是一份复杂的 10 页供应商发票。n8n 的 webhook 抓取邮件,触发一个本地 API 调用到你的 Mac 集群。集群上跑着像 Devstral 123B 这样 1200 亿参数的巨型模型。

EXO 编排层瞬间将工作负载分配到四台机器上。模型读取 PDF,提取类目,并与你的 Xero 采购订单进行比对。它生成一个严格的 JSON 响应。n8n 接收 JSON 并通过 API 更新 Xero 里的发票行项目。

你的数据从未离开过这栋楼。就算你拔掉办公室路由器的网线,系统照样能完美处理发票。

账也算得过来。硬件投入大约 £40,000。在高负载下,整个集群耗电约 500W,比一台商用咖啡机还省电。这 £40,000 分摊到三年里,你运行主权级、GPT-4 级别的本地 AI,成本比雇一个初级财务助理还低。

这里主要的故障点是“编排超时”。如果你的 n8n 实例跑在一个很慢的本地服务器上,webhook 可能会在集群还没生成完 JSON 之前就断开连接。解决方法是在 n8n 的 HTTP Request 节点里明确设置超时延长,并将每次失败记录到专门的 Slack 频道。你还需要在本地固定模型版本,免得一次意外更新毁掉你的 JSON 结构。

哪里会掉链子

如果你的输入数据毫无结构,或者内部网络一团糟,这种本地集群方案也会彻底歇菜。

本地大模型是文本预测引擎,不是魔法。如果你的发票是从老旧财务系统里扫出来的 TIFF 图片,你得先做 OCR(文字识别)。如果你直接把模糊的扫描件喂给本地视觉模型,错误率会从 1% 飙升到 12% 左右。到时候你改错花的时间比手动录入还多。

网络环境太差也不行。这些 Mac 需要稳定的以太网连接来进行管理访问,这得跟 Thunderbolt 网格完全分开。如果你的办公室网络老是丢包,内部 API 调用就会失败。n8n 报错超时的时候,集群只能在那儿干瞪眼。

买硬件之前,先检查一下你现有的流程。如果你的运营经理现在都画不出审批合同的准确决策树,那 AI 模型也干不了这活儿。一台 £40,000 的 Mac 集群只会以每秒 25 个 token 的速度自动制造错误。在引入本地算力之前,你需要严格、书面化的工作流。别指望买回硬件就能奇迹般地理顺你那乱七八糟的后台。

问题不在于 AI 是否会取代你的运营经理。而在于你是否清楚,在她每周的工作里,哪部分价值 £32k 的时间其实是在对着 Xero 和 Stripe 这种账目——因为今年只有这部分是机器人能碰的。如果你一直依赖云端 API,你就永远被局限在“法律允许发往加州的数据”之内。搭一个本地 Mac 集群会改变你公司的底层逻辑。你既能拥有顶尖模型的推理能力,又能拥有像带锁文件柜一样的数据安全性。这事儿折腾几周就能成,成本比招错一个人还低。别等微软给你搞什么“足够安全”的套壳了。买硬件,插线,自己跑模型。

订阅获取 UK AI 洞察。

针对英国企业的 AI 实战内容 —— 拆解、教程、监管解读。随时取消。

随时取消。