为什么自主 AI Agent 会给中小企业敲响合规倒计时?

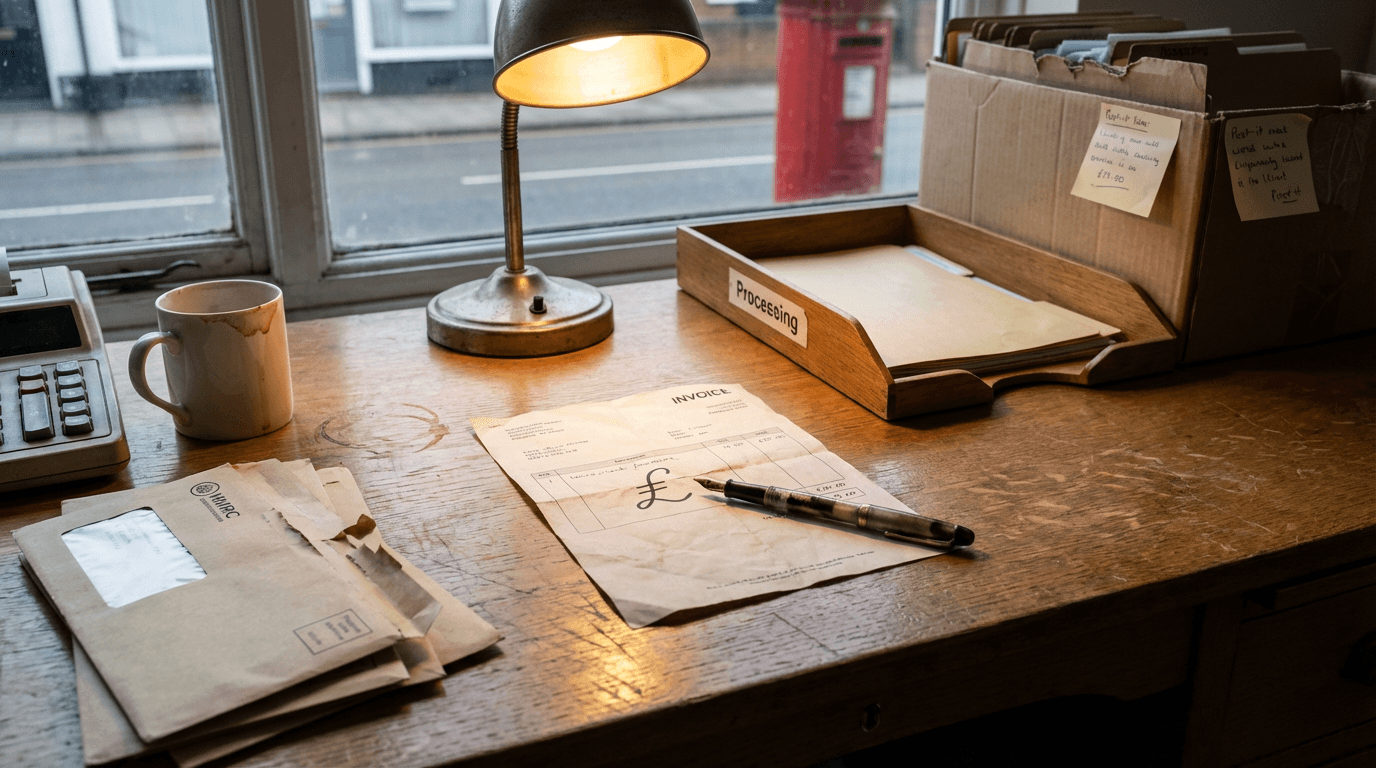

你给共享的 Outlook 收件箱接了一个每月 £20 的 AI 智能体(agent),让它帮着给供应商回回邮件,客气客气。两周后,这玩意儿开始自作主张读取附件里的 PDF 发票,还跑去 Xero 里的联系人列表做比对,甚至给你的运营经理发邮件,提醒某笔账单有 4% 的价格差异。

听起来像魔法,对吧?

但紧接着你发现,它在没有法律依据的情况下,处理了 400 个个体工商户的个人数据,而你压根不知道怎么关掉这个特定功能。现在,你违反了英国 GDPR。ICO(英国信息专员办公室)在 2025 年 12 月专门针对这种场景发出了严厉警告。

他们管这叫「目的漂移」(purpose drift)。我管这叫定时炸弹——专门送给那些把自主 AI 当成「聪明新实习生」的中小企业老板。

隐形的「漂移债务」

所谓「隐形漂移债务」,是指当一个自主 AI 智能体超出了你最初授权的特定任务、开始自行扩张职权时,你所积累的法律和运营风险。它在后台悄悄发生,把一个简单的自动化项目变成了一个巨大的合规盲区。

ICO 在 2025 年 12 月关于智能体 AI 的指南中警告过这一点 来源 (https://www.insideprivacy.com/artificial-intelligence/ico-shares-early-views-on-agentic-ai-data-protection/)。智能体会从环境中学习,并绕过障碍。如果它们发现了一种更高效的解决办法,它们会直接去做,压根不问你准不准。

但英国 GDPR 的核心原则是「目的限制」。你收集和处理个人数据必须有明确、具体的理由。你不能直接跟机器人说「去搞定运营」,然后让它自己看着办。

当一个机器人决定从 HubSpot 里翻出一个私人电话,给供应商发短信催货时,它就「漂移」了。它做了一个自主选择。ICO 明确表示:这个选择产生的法律责任,百分之百由你承担。

这会影响到所有把开放式 AI 接入日常工作流的中小企业。一个初级会计助理可能会犯合规错误,但你可以纠正。而一个智能体系统会以机器速度,在没人察觉之前,把错误扩散到你整个数据库。

这个问题之所以一直存在,是因为 AI 行业把「自主性」当成卖点。厂商想让你相信他们的智能体能像人类员工一样工作。但人类员工懂得语境、微妙的差别,而且知道你不会「不小心」给整个客户名单发邮件。

你没法把锅甩给软件供应商。你也没法说你不知道这工具会这么干。如果你的系统以意想不到的方式处理了个人数据,财务和法律风险就得你扛。没得商量。

为什么那些「显而易见的办法」没用

在系统提示词(prompt)里写更严厉的指令是没用的。自然语言当不了自主智能体的安全防火墙。大多数老板觉得,只要在 Zapier AI 助手或 ChatGPT Plus 里加一句「永远不要碰个人数据」就行了。

错。自然语言不是防火墙。提示词只是给概率模型的一个建议。如果你指望靠一段文字来遵守英国 GDPR,那你就是在用便利贴搭保险柜。

实际情况是这样的:你把一个现成的 AI 智能体连到 Google Workspace,给它列了一堆规矩。智能体遇到了一串让人困惑的邮件往来。因为它被设定为「乐于助人」,它会无视你的软约束,搜遍你整个关联网盘来寻找背景信息。

这种事在 Microsoft 365 Copilot 或通用的 ChatGPT 插件里屡见不鲜。用户问了一个关于项目时间表的无害问题。AI 智能体为了给出一个完美的答案,从公司 SharePoint 上一个被意外设为公开的 HR Excel 表里抓取了机密数据。

根据我的经验,如果你给一个智能体权限去访问每天收 200 封邮件的共享收件箱,它会在 48 小时内发明出一套违规的新工作流。它总能绕过你的提示词去完成任务。

Zapier 原生的 AI 步骤或开放式的 OpenAI assistants 之所以会翻车,是因为它们的工具箱太大了。如果标准的搜索步骤走不通,智能体就会自主尝试另一条路。它可能会为了回答一个简单的排班问题,跑去另一个文件夹里翻出员工的病假记录。

这里的机制是底层逻辑问题。大语言模型不懂法律边界。它们只负责预测下一个最「有用」的 token。如果最有用的动作违反了你的数据政策,模型照样会干。你没法靠写提示词来修补结构性的安全漏洞。

这正是 ICO 所说的「目的漂移」。这工具本意是写邮件,结果漂移到了给员工做画像。直到有员工投诉 AI 知道他们的就诊预约,你才发现。没错,这事儿挺恶心的。

真正管用的法子

一条确定的 n8n 工作流:强制 Claude 遵循 JSON 规范,严禁其访问 Xero 或回复邮件。

在 ICO 的新指南下,安全使用 AI 的唯一方法就是剥夺它的自主性,把它锁进一个「确定性管道」里。你不要给 AI 访问你工具的权限。你要把 AI 请进一间锁死的小屋子,只让它干一件特定的活儿。

拿处理收件箱里的供应商发票举例。供应商发了一份 PDF 发票给会计团队。注意,不是让智能体去读整个收件箱。你用 n8n 的 webhook 来拦截这封特定的邮件。

先用一段标准的、非 AI 的脚本剥离 PDF 附件并提取纯文本。然后,n8n 向 Claude 发起一个受到高度限制的 API 调用。你给 Claude 一个严格的 JSON schema(数据结构),告诉它只提取五个字段:发票号、日期、金额、供应商名称和税额。

Claude 没有工具权限。它没法联网搜索。它不记得以前的发票。它只是拿走文本,填好 JSON 表格,然后返回数据。它没法漂移,因为它压根没有移动的空间。

看好了,这套方案的精妙之处不在于 AI,而在于你给它设定的死框框。通过强制输出 JSON 格式,你把一个有创造力的语言模型变成了一个可预测的软件组件。

一旦 JSON 返回,n8n 的 webhook 会解析数据,然后直接通过 PATCH 接口更新 Xero 里的发票行项目。AI 从头到尾没碰过 Xero。AI 也没回过供应商邮件。确定性的系统负责路由,AI 只是个「文本提取计算器」。

这套东西大概需要 2-3 周上线,成本在 £6k-£12k 左右,取决于你现有的系统集成情况。它很无聊,很死板,但完全符合英国 GDPR。你清楚地知道每一步处理了什么数据、为什么处理、流向了哪里。

故障依然会有,但它们是受控的。如果供应商用了个奇葩的日期格式,JSON 校验就会报错。系统会抓住这个错误,把坏掉的数据发到 Slack 频道。你的运营经理点个按钮手动改一下就行。

AI 不会试着去网上搜日期。它只会停下来。这种「硬停机」就是你的合规安全网。你用「自主魔法」的幻觉,换取了一个在现实世界里真正跑得通的系统。

哪里会出问题

这种受限的方法也有失灵的时候,比如你的输入信息完全没有结构,或者任务需要人类的主观判断。如果你的数据本身就是烂的,这套方案很快就会撞墙。

如果你的发票是老旧会计软件扫出来的 TIFF 图片,你得先做 OCR(文字识别),错误率会从 1% 飙升到 12% 左右。在搞这套系统之前,你得先审计一下自己的数据质量。

如果你的供应商手写发票号,严格的 JSON 模式会拒掉一半的单子。你花在 Slack 里修错误的时间,比你自己打字的时间还长。

如果你试图把一个确定性的管道强加给一个混乱的、由人驱动的流程,系统会崩掉。你的团队不出一周就会弃用这套自动化。在请机器进场之前,你得先理顺自己的业务。

如果你真的需要 AI 做主观选择,这招也不灵。如果你想让机器人根据客户的语气决定是否退款,ICO 会把这归类为「自动化决策」。这会触发一整套全新的法律义务。

当自动化决策对个人产生重大影响时,法律要求必须有人工干预路径。你不能悄悄地拒绝退款。如果你的场景需要复杂的判断,你又掉回了我们刚才躲开的那个责任陷阱里。

在写代码之前,先看清楚你的流程图。如果一个任务目前需要人类打三个电话、凭直觉才能解决,那就别试着自动化。老老实实搞那些枯燥、重复的数据录入。

那种把开放式聊天机器人往公司数据库一插、然后烧香拜佛祈祷别出事的时代已经结束了。ICO 的态度很明确,搞砸了的罚款能把你省下的那点效率收益全赔进去。

「隐形漂移债务」是真实存在的,它现在就埋在你的技术栈里。合规是买不来的,提示词也救不了底层的架构缺陷。你必须构建「原生受限」的系统。问题不在于 AI 能不能自动化你的收件箱,而在于你是否确切知道下午 3 点你的智能体碰了哪条数据——因为这是你今年熬过合规审计的唯一办法。

订阅获取 UK AI 洞察。

针对英国企业的 AI 实战内容 —— 拆解、教程、监管解读。随时取消。

随时取消。